自動化のさらに先へ - 企業が目指すべき「自律型SOC」とは

企業においてセキュリティ対策の中核を担うSOC。体制を整える企業が増える一方、SOC運用の負担は年々増加しており、従来の“自動化”や手作業での対応は限界を迎えつつあります。そのなかで次のステージとして注目を集めているのが、AIを活用した「自律型SOC」です。本記事では、SOCが抱える課題から、自律型SOCが求められる背景を紐解くとともに、その概要・メリットなどを解説します。

既存のSOCが抱える課題

セキュリティリスクが高まるなか、SOCを整備する企業が増加

24時間365日体制でサイバーセキュリティインシデントへの対処をおこなう専門組織であるSOC (Security Operation Center)は、組織内にあるログの収集・監視から、インシデントの検知、調査・分析、報告や対処まで全般を担います。クラウド活用や働き方の多様化により守るべき範囲が広がり、対策の難易度がますます高まっていることから、インシデントに迅速に対処し、被害拡大を防止すべく、SOCの体制を整える企業が増えています。

人材・ナレッジが不足し、担当者の負担は増す一方

しかし、SOCの運用には課題も多く、まず挙がるのが人材確保の問題です。SOCには高度な知識を持つセキュリティアナリスト・セキュリティエンジニアなどが不可欠ですが、こういった人材は慢性的に不足しており、「必要な人材を確保できない」「ナレッジが不足している」と悩むケースは少なくありません。

さらに、サイバー攻撃が激化するなか、SOCメンバーの負担は増える一方です。クラウドからオンプレミスまで、求められるナレッジの範囲も量も増え続けており、インシデント分析や、適切な対処の判断も難しくなっています。

負担軽減の方法として、事前に定めたルールに基づいて、異常検知時に自動で端末の隔離などをおこなう「自動化」も徐々に進んでいますが、それにも限界があります。例えば、最近増えている「Living off the Land」という攻撃手法では、OSの標準プロセスなど正規のツールや機能を悪用して攻撃をおこなうため、従来のようなマルウェアのように検知することが困難です。様々なナレッジをベースに「標準プロセスがどのような使われ方をしているか」「普段と違う行動はないか」「攻撃によくある動きをしていないか」など1つずつ細かく分析し、判断する必要があり、担当者の負担はますます増加しています。

SOCにおけるAIの活用方法:ベストプラクティスとチェックリスト

「自律型SOC」とは

AIを活用し、人の負担を最小限に抑える「自律型SOC」

こういったなか注目されているのが、AIを活用してセキュリティ運用をおこなう「自律型SOC」です。これは、調査や分析、レポート作成など従来の自動化ではカバーしきれなかった領域にAIを活用し、担当者の介入を最小限に抑えてセキュリティ運用を実現する体制を指します。具体的には、ログの収集や分析、対応策の検討などの“作業”をAIに任せ、担当者はAIがまとめた情報をもとに判断のみを担当するイメージです。

「自律型SOC」のメリット

少人数で、より確実なセキュリティ運用が可能に

自律型SOCの最大のメリットは、担当者の負担を軽減し、少人数でも効率的な運用を可能にする点にあります。AIを「ナレッジを補完し、担当者をサポートするパートナー」として活用することで、高度な知識を持つ担当者の負担軽減だけでなく、ビギナーレベルの担当者が対応可能な範囲も広がります。

また、複雑な分析作業をAIが代替することで、工数削減だけでなく、MTTD (平均検出時間、Mean Time to Detect)やMTTR (平均復旧時間、Mean Time to Recovery)の短縮にもつながります。近年、サイバー攻撃の手法は複雑化しており、異常を検知するアラートが通知されても、分析に時間がかかり、攻撃者が先に機密情報の窃取・暗号化などの目的を達成してしまうケースも見られます。AI活用により対応時間を短縮することで、迅速な対処と脅威の封じ込めが可能になり、被害拡大防止の観点でも効果を期待できます。

セキュリティ人材不足をSplunk Agentic AIで乗り越える

Splunkが描く次世代SOCを解説するとともに、実際のデモを通じて、AIがどのようにセキュリティ運用を劇的に効率化するのかをご紹介します。

自律型SOCの注意点

出力する情報の精度

自律型SOCに限らず、AI活用全般で課題となっていますが、AIが出力する情報は100%の精度ではなく、誤検知・誤対応のリスクがあることを前提に活用する必要があります。ナレッジ不足を補完する存在として期待されるものの、AIが出力した分析結果やレポートをそのまま信用するのではなく、「誤りがないか」をチェック・判断するためのナレッジが不可欠です。

情報漏えいの懸念

AIでデータを分析するには、外部のLLM (LargeLanguage Model)などにデータを渡すことになります。精度を高めるためにも、社内のネットワークやデバイスなどあらゆるログをまとめて提供するもしくはMCPなどで連携する必要があり、情報漏えいやコンプライアンスを懸念するケースも見られます。事前に社内の規制やルールに適合しているか確認することをお勧めします。

自律型SOC成熟度モデル

従来のSOCから自律型SOCへと進める際に参考になるのが、自律型SOC成熟度モデルです。自動化やAI活用の段階に応じて5つのレベルに分けられており、レベルが上がるにつれ組織としての成熟度が高まります。

レベル0 (手動)

セキュリティの運用を完全に手作業でおこなっている状態を指します。アラート対応やログの分析もすべてセキュリティアナリストがおこなうため、属人性が高くなり、対処に時間がかかるほか、人的ミスが発生するリスクもあります。

レベル1 (ルールベースの自動化)

次の段階は作業の「自動化」です。「ログイン失敗を繰り返す端末を隔離する」など一次的な対処を自動化します。ただし、あくまでも事前に設定したルールに基づいてプロセスを自動実行するのみに留まり、その後の分析や対応は担当者が主導します。

レベル2 (AI支援型運用)

レベル2からは、いよいよAIの活用が始まります。ただし、この段階では、AIはあくまで人の作業を補助するツールであり、人が主導して作業を進めます。しかし、AIと対話しながら作業を進めることで、大幅な高速化が期待できるうえ、自然言語ベースでのやり取りにより経験の浅いメンバーでも効率的な脅威の調査・分析が可能になります。

レベル3 (部分的自律運用)

レベル3では、調査や分析など多くの作業をAIが担い、人はインシデント対処の“判断”に専念します。これは「Human in the Loop」という設計思想に近く、意思決定・判断の領域に人が介在することで、対応の精度と信頼性を担保します。SOCのセキュリティアナリストやエンジニアは、ログ収集や分析といった定型作業から解放され、より戦略的な判断や最適化に注力できるようになります。

レベル4 (高度な自律運用)

レベル4は、インシデントの検知から分析・対応・報告までをAIが自律的におこない、日常的な運用に人が介在する必要がない状態となります。これは、ある種の「理想形」と言えるものであり、AI技術の進化とともにその実現可能性が期待されています。

自律型SOCの実装イメージ

現時点では、主に自律型SOC成熟度モデルのレベル2~3に相当する形でAIが実装・活用されています。ここでは、それぞれ具体的にどのように実装されているのかを解説します。

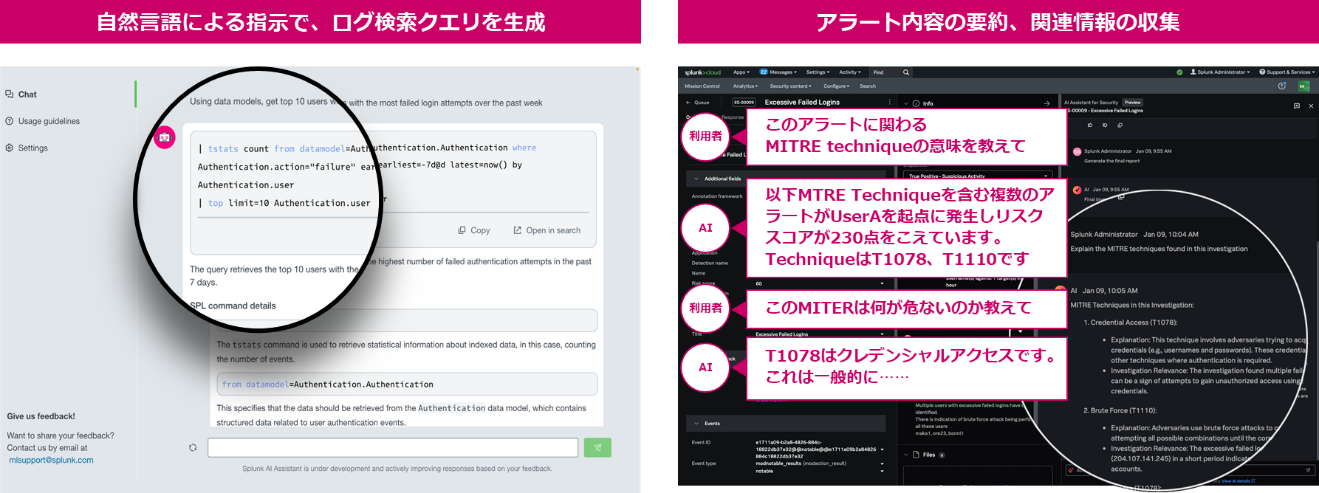

<成熟度モデル・レベル2>ログ検索用クエリの生成・関連情報の収集

セキュリティアナリストが状況を分析する際には、ログ検索のためのクエリを作成する必要があります。AIを活用することで、自然言語による指示だけで複雑なクエリも簡単に生成でき、作業効率が大幅に向上します。このほか、アラート内容の要約や、関連情報の検索なども可能で、AIを“相談相手”として活用することで、スムーズに調査・分析を進められます。

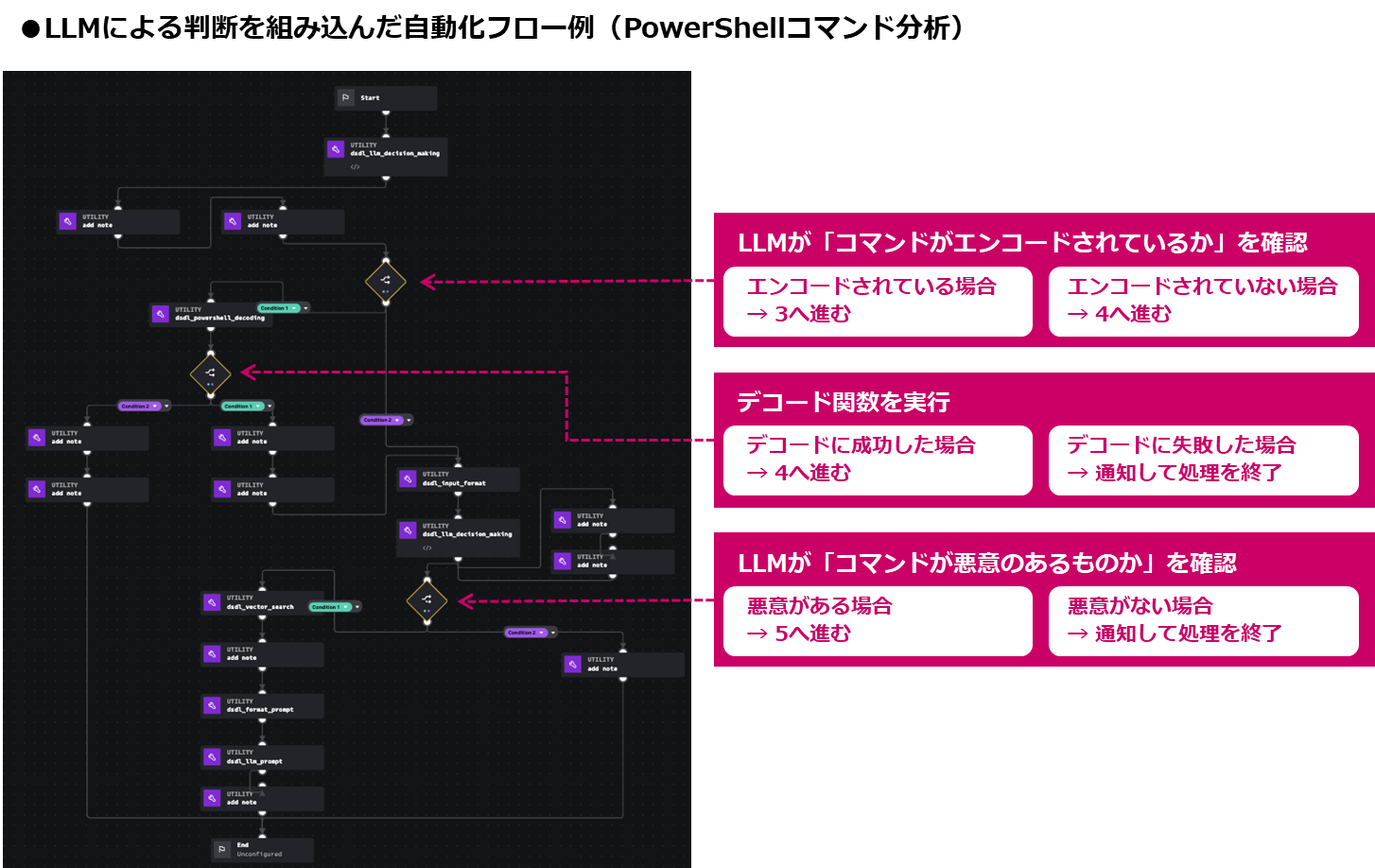

<成熟度モデル・レベル3>自動化フローにLLMの判断を実装

SOARなどの「自動化」フローにLLMによる判断を組み込んで実装することで、自動化の範囲が大きく広がります。

たとえば、下図の例では、PowerShellコマンドの入力に対し、「エンコードされているか」「悪意があるか」などをLLMで判断し、その結果に基づいて分岐する形でフローが進行します。広範囲にわたってAIが調査を代行し、最終的に人が妥当性をチェックするだけで対処が完了するため、対応の迅速化と大幅な負担軽減を実現できます。

もちろんフローの設計には一定の知見が求められますが、ここでもAIを活用し、自然言語による指示からフロー自体を作成することも可能です。

セキュリティ運用でのAI活用は不可避。自律型SOCに向けた体制強化を

SOCのミッションは、自社の様々な資産をサイバー攻撃から守ることにありますが、攻撃者側が積極的にAIを活用する今、守る側もAIを取り入れなければ対抗できなくなりつつあります。より迅速かつ効率的な対処を実現する「自律型SOC」に向けた体制強化は欠かせません。

とはいえ、いきなりAIを活用できるわけではなく、まずはログの可視化・統合を進め、全体の状況を把握できる環境が整っていることが前提です。そのうえで、自動化を進めながらAIを取り入れ、徐々に自律的に対処できる範囲を広げていくアプローチをお勧めします。

Splunk Enterprise SecurityはAI機能を標準で搭載しており、集約したログをもとにスムーズにAI活用をスタートできます。AIは単なるツールで終わらせるのではなく、パートナーとしてどこまで活かせるかが、企業のセキュリティ対策の鍵と言えるでしょう。

SOCにおけるAIの活用方法:ベストプラクティスとチェックリスト

SOC業務は、AIでどう変わるのか?

Enterprise Securityですぐに使えるAI Assistant機能をデモを交えて、詳しくご紹介します。