AI Agent MonitoringとAI Infrastructure MonitoringによるAIアプリケーションスタックの健全性、パフォーマンス、セキュリティの監視

昨年の.conf25で、Splunkのオブザーバビリティの新たな章を開く画期的なイノベーションを発表しました。それはAIを活用した統合的なエージェント型ソリューションであり、IT運用チームやエンジニアリングチームは、AI時代におけるデジタルレジリエンスを強化できます。AIやLLM (大規模言語モデル)の大量かつ複雑なワークロードが本番環境に投入されるこのAI時代には、業界や業務全体の効率化、ワークフローの自動化、「バイブコーディング」の導入が急速に進む一方で、アプリケーションパフォーマンス、コンプライアンス、動作、リソース消費、精度などの問題が次々と生じています。これらの問題の頻度や深刻さは、基盤となるインフラの強度と安定性に大きく依存します。AIスタックの可視化と保護を通じてこの課題を緩和するのが、Splunk Observability CloudのAI Infrastructure MonitoringとAI Agent Monitoring、そしてAppDynamicsのAI Agent Monitoringです。

AI Infrastructure Monitoring

AI時代に入って、インフラに変革が起きています。今日のインフラを構成するのは、クラウドコンピューティングやホストサーバーなど、従来のコンポーネントだけではありません。AIのワークロードとリソース使用率を管理するために、レイヤーを追加する必要があり、複雑さが増しています。また、市場での競争力を維持し、顧客の要求に応え続けるには、保守に重点を置くだけでは不十分になっています。

IT運用チームとエンジニアリングチームは、LLM (大規模言語モデル)、ベクトルデータベース、AIフレームワーク、AIライブラリ、インフラスタックの追加レイヤーなど、環境全体でパフォーマンスの問題、性能の低下、非効率性にリアルタイムで対処するために、これまで以上に迅速かつコスト効果の高い検出と対応を求められています。このレベルの可視化を実現すれば、システムの信頼性、セキュリティ、拡張性に自信を持って、将来を見据えたLLMやエージェント型アプリケーションを構築できます。

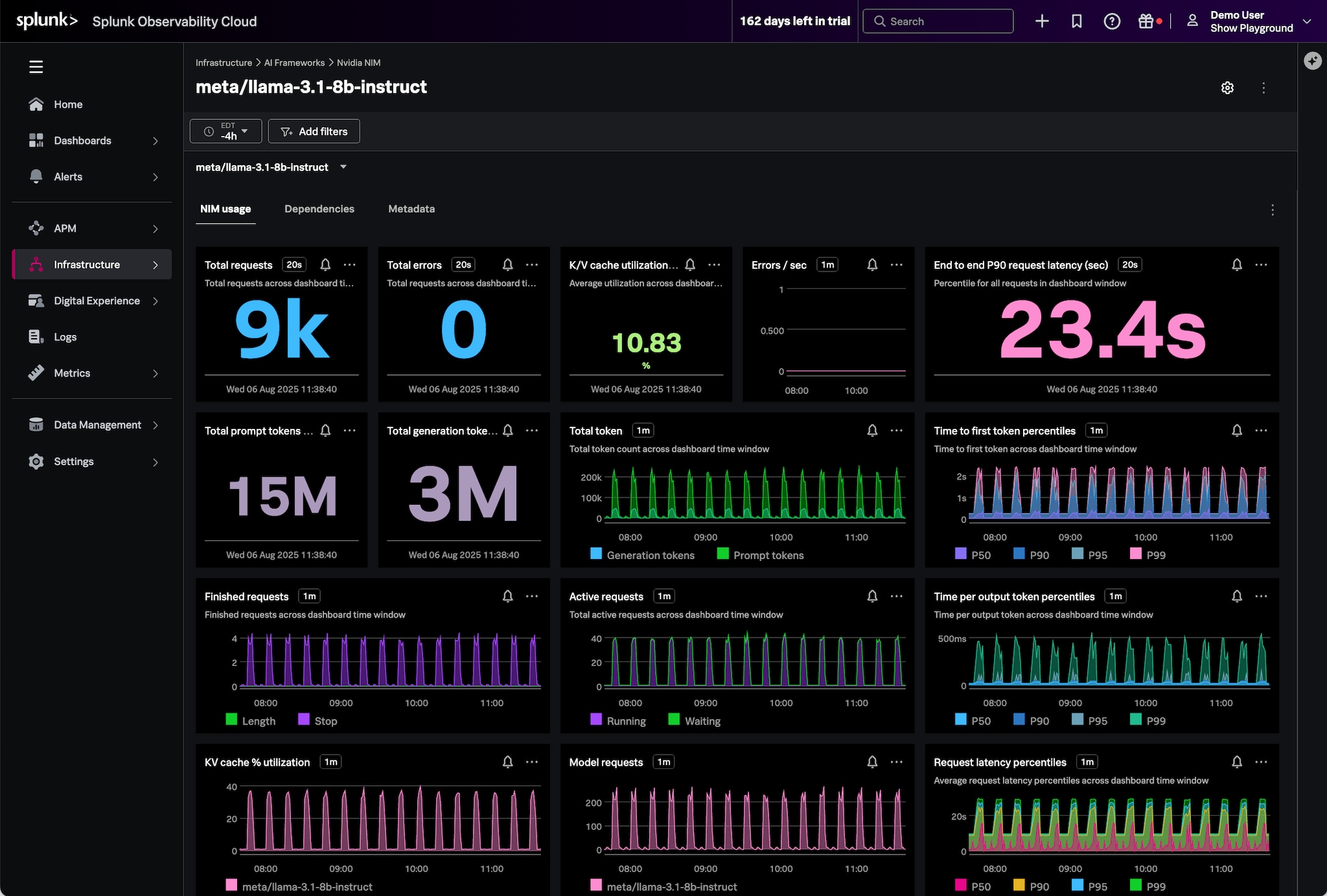

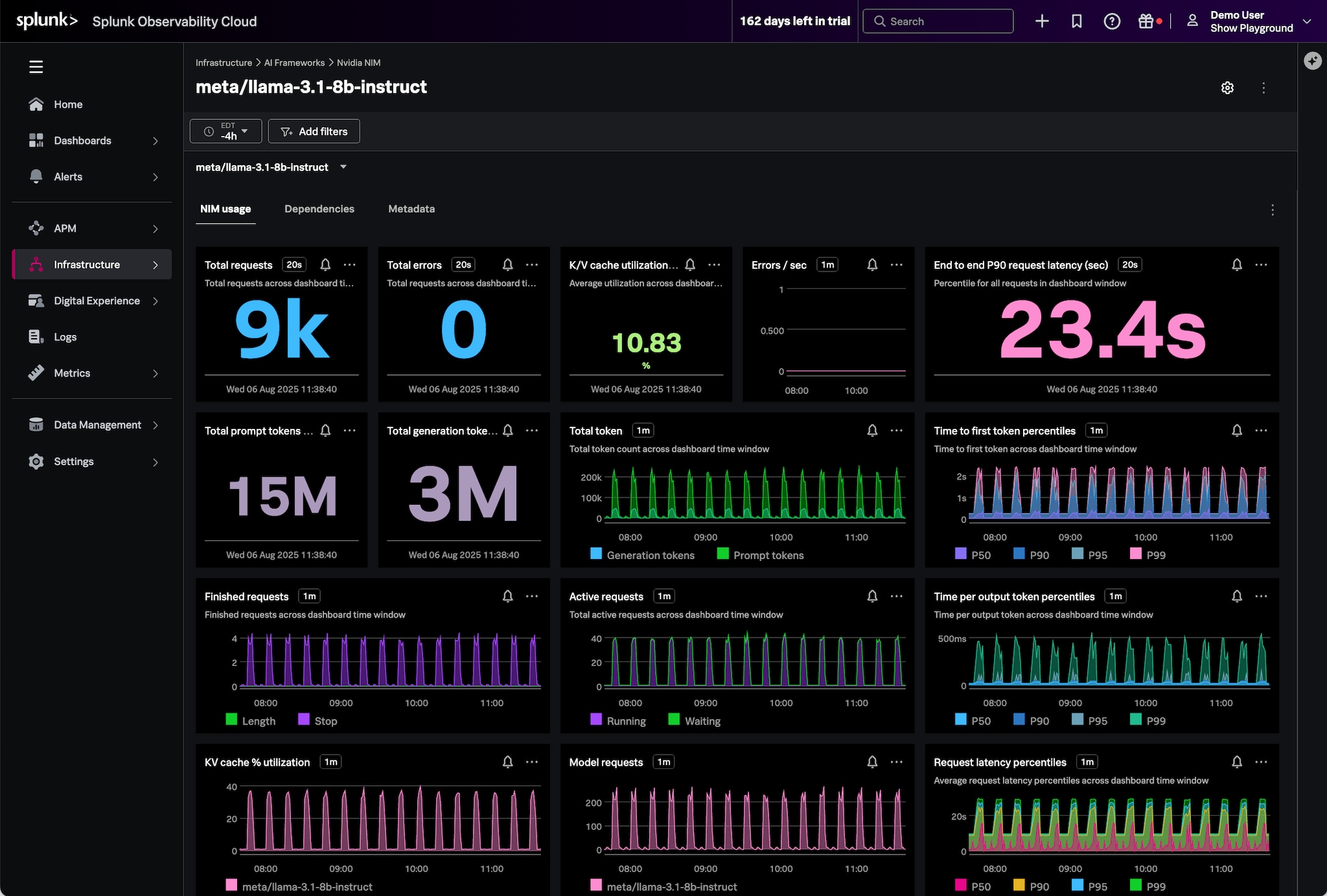

AI Infrastructure Monitoringでは、豊富なデータが表示されるダッシュボードで、アクティブノードと保留中のノード、GPU/CPUの使用率と使用状況、リソースの割り当てなど、AIインフラコンポーネントを監視できます。AWS Bedrock、Azure OpenAI、GCP VertexAI、LangChain、NVIDIA GPU、NVIDIA NIM、OpenAI、Ray、Weaviateなど、数多くのAIコンポーネントがサポートされ、ワークロードのニーズにより効率的に対応するAIシステムを構築、展開、監視、管理できます。これは、モデルとインシデントの管理ライフサイクル全体を通じて拡張性を確保し、コンプライアンス要件に対応するのに役立ちます。「ノイジーネイバー(うるさい隣人)」、制限によるエラー、リソースの競合、トレーニングジョブの失敗など、不可避の問題が発生した場合でも、根本原因を特定し、適切にトラブルシューティングを行って、運用メトリクスに関するアラートを生成できます。

AIスタックをエンドツーエンドで可視化することで、安定性、可用性、セキュリティに影響する問題が生じているAIインフラコンポーネントをすばやく発見し、ビジネスの健全性、使用傾向、パターン、外れ値と相関付けて、パフォーマンスや組織の評判低下のリスクを緩和できます。

たとえば、Cisco AI PODをベースとするAIインフラを運用しているとします。Cisco AI PODは、トレーニング、ファインチューニング、推論のワークロードを含むAIライフサイクル全体をサポートするように設計された、事前検証済みのフルスタックのデータセンターインフラソリューションです。検証済みのアーキテクチャスタックとファブリック設計に基づいて構築され、リファレンスとしてすぐに使えるブループリントを提供して、迅速な展開を可能にします。このインフラは、NVIDIAとAMDの最新GPUを搭載したCisco UCSサーバー、高性能ネットワーク用のNexus 9000シリーズスイッチ、統合ソフトウェアコンポーネント(管理用のCisco Intersight、コンテナオーケストレーション用のRed Hat OpenShiftなど)で構成されます。Cisco AI PODは、小規模なエッジ展開から大規模なデータセンタークラスターまで、モジュール方式で拡張が可能で、柔軟性、セキュリティ、効率に優れたAI運用を実現します。また、オブザーバビリティとセキュリティのための拡張機能も含まれます。

このCisco AI PODインフラでAI Infrastructure Monitoringを使えば、重要なAIインフラコンポーネントをリアルタイムで包括的に可視化して、AIワークロードの効率を最適に保つことができます。たとえば、NVIDIA GPUや、Red Hat OpenShift上で実行されるコンテナ化AIアプリケーションの健全性とパフォーマンス、電力使用率、ストレージのパフォーマンス、ネットワークなどを監視できます。また、AI Infrastructure Monitoringで提供される実用的なインサイトや予測分析に基づいて、異常をすばやく検出し、リソースの使用を最適化して、シームレスなAI運用を維持できます。AIインフラの信頼性を向上させれば、高速で質の高いアプリケーションの実行基盤を築くことができます。

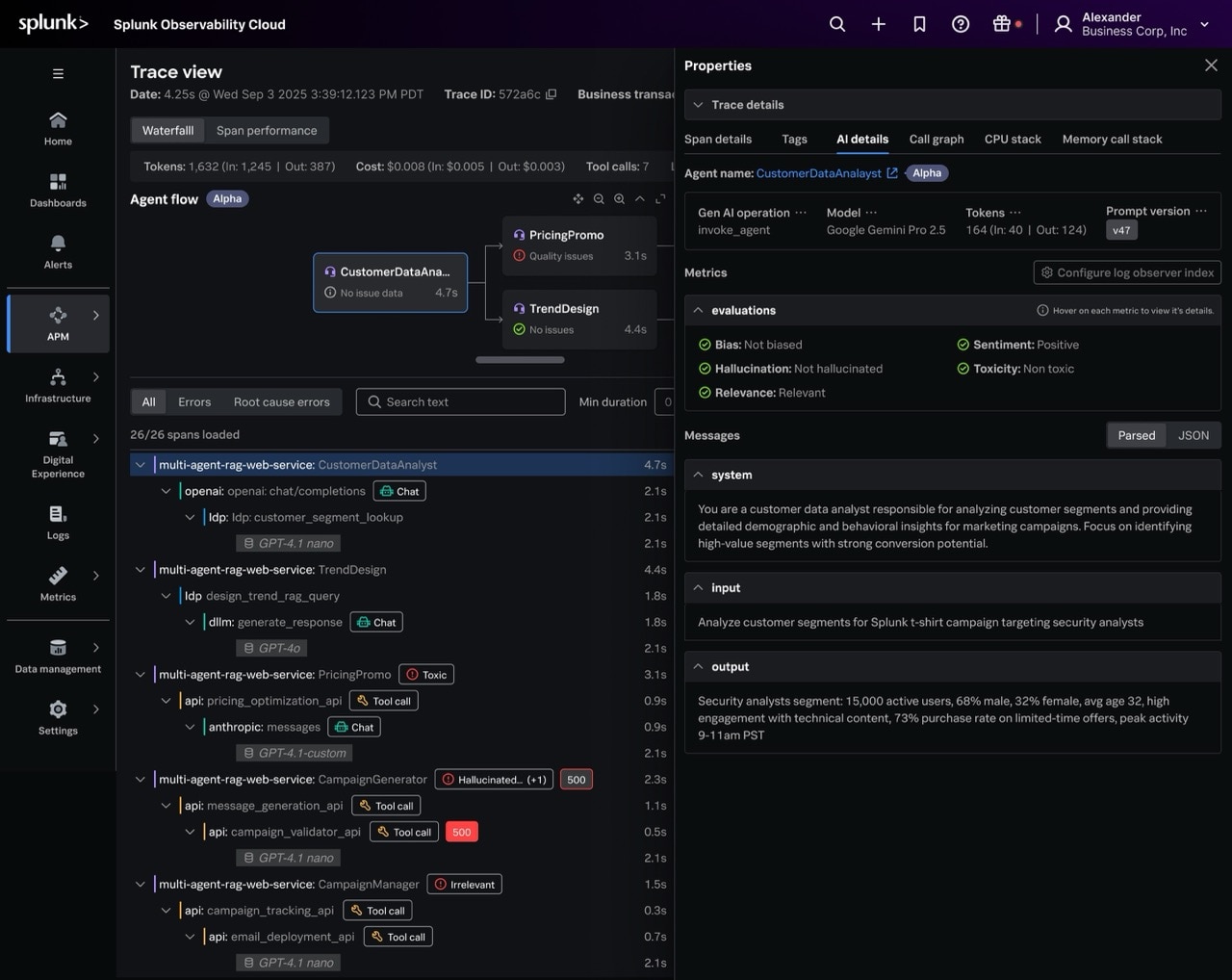

Observability CloudのAI Agent Monitoring

この新しい時代に、AIエージェントやAIアプリケーションが、自動化、生産性向上、コスト軽減を新たなレベルに引き上げ、あらゆる業界で組織の競争力を高めています。ただし、従来のアプリケーションとは異なり、LLMの非決定論的で生成的な動作が、不正確さ、バイアス、虚偽を頻繁に含む出力を招くことがあります。本来の用途から外れると、このような問題が最終的には顧客からの信頼低下、エンドユーザーエクスペリエンスの劣化、コストの増大につながる可能性があります。

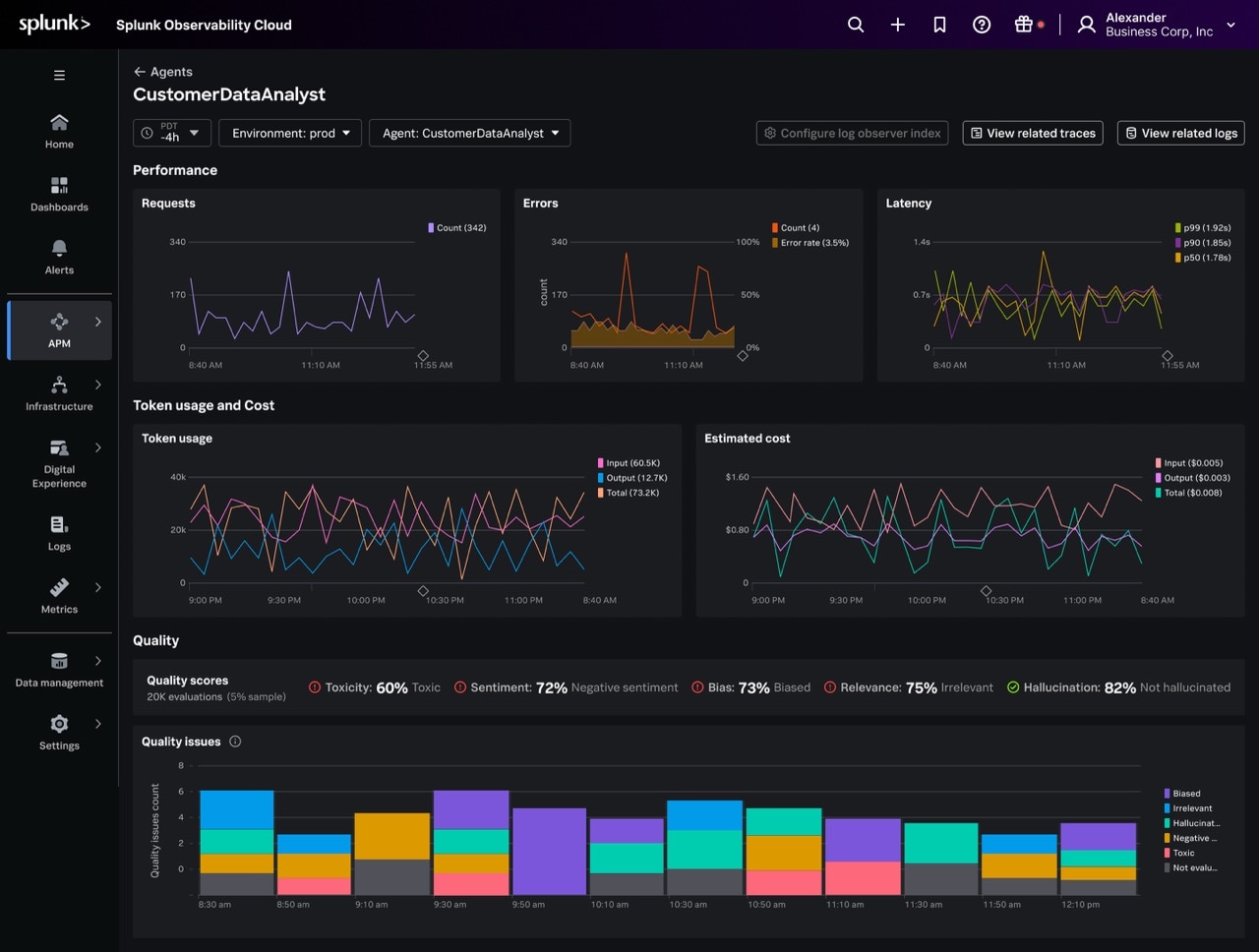

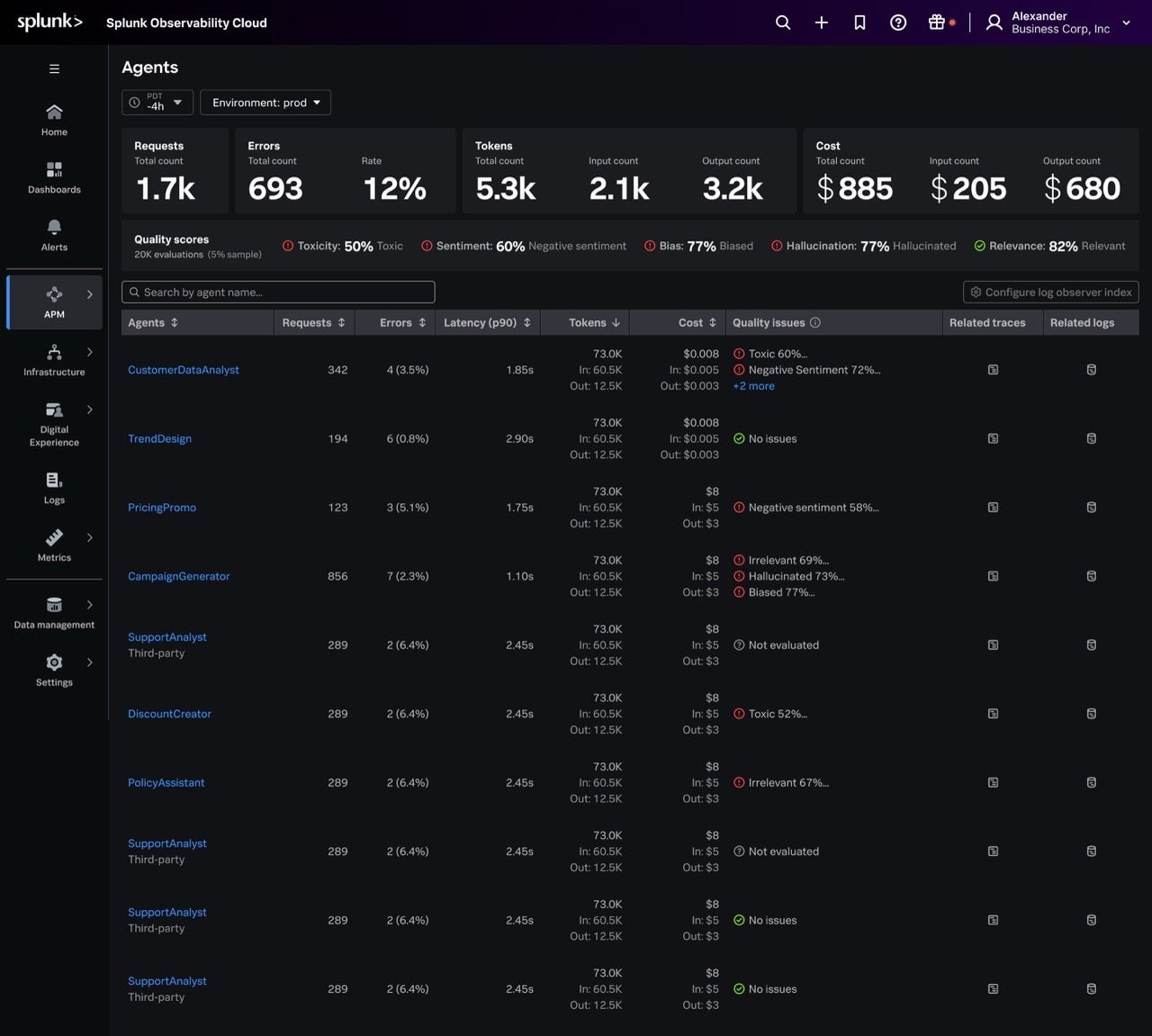

高性能なLLMやエージェント型アプリケーションを構築および保守するには、詳細かつ包括的な可視化を実現して、信頼性、精度、品質、セキュリティの問題をすばやく特定、調査、解決できるようにする必要があります。AI Agent Monitoringを使えば、IT運用チームやエンジニアリングチームは、LLMを利用するエージェント型アプリケーションのパフォーマンス、コスト、動作をプロアクティブに監視して、ユーザーエクスペリエンスに影響を与える問題を早期に検出できます。また、AI Agent MonitoringはOpenTelemetryとシスコのAGNTCYという業界標準を基盤としているため、AI監視におけるベンダーロックインを回避することもできます。

AI Agent Monitoringでは、トランザクションのトレースをフィルタリングおよびサーチして、パフォーマンス、品質、コストに関する問題がいつ、どこで、どのように、なぜ発生したかを調査および特定できます。これらのインサイトは、アノマリ検出やトラブルシューティングの迅速化に役立ちます。

すぐに使える視覚オブジェクトを使ってユーザーの操作を追跡することで、ツールの呼び出しやシステムからのプロンプトなどを含むエージェント機能のワークフローを可視化し、ユーザーとエージェント型アプリケーションとのやり取りのコンテキストを把握することもできます。これにより、エラーや遅延といったパフォーマンスに関する従来の問題に加えて、モデルのドリフトやハルシネーション(幻覚)など、LLM固有の問題も調査できます。

さらに、Cisco AI DefenseがAI Agent Monitoringに統合される予定です。これにより、プロンプトインジェクション、データ漏えい、有害なコンテンツなどのAIリスクを検出および緩和できるようになります。AIのセキュリティリスクをインフラと関連付けることで、侵害を防止し、コンプライアンスを確保して、運用のレジリエンスを維持できます。

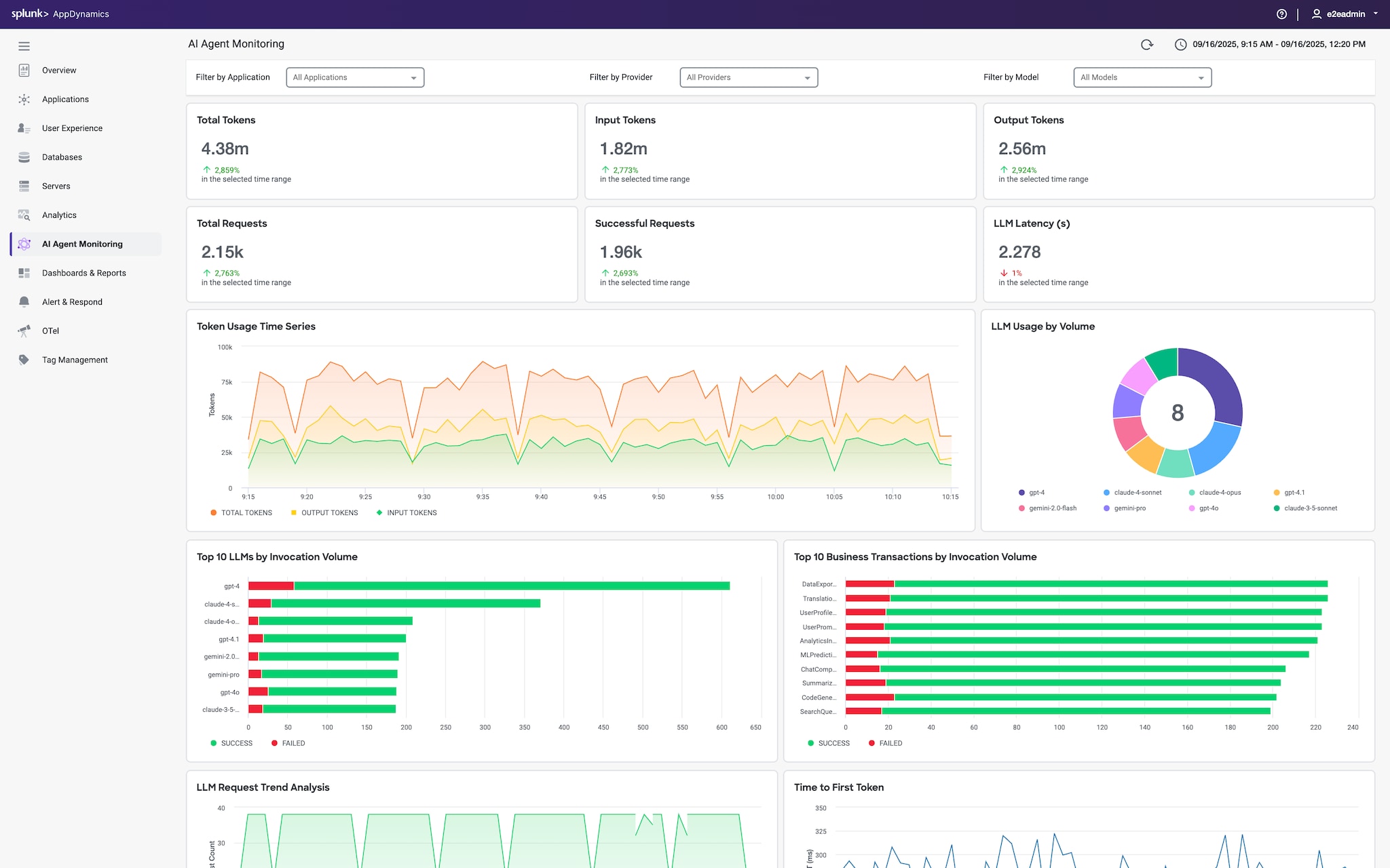

AppDynamicsのAI Agent Monitoring

AppDynamicsではLLM Monitoringも提供されます。このソリューションでは、1つの統合的なインターフェイスで、AIエージェント、インテグレーション、基盤インフラをリアルタイムで監視できます。

AppDynamicsのAI Agent Monitoringでは、LLMの使用状況を追跡し、社内ポリシーや規制要件に合わせて調整することで、コンプライアンスを確保し、違反リスクを低減できます。リソース消費量や運用コストを明確に可視化できるため、コストの最適化、リソースの効率的な割り当て、コストの主要因の特定が容易になります。

健全性とパフォーマンスの監視を効率化して、異常をすばやく検出し、問題に未然に対処することで、エンドユーザーやビジネスクリティカルなアプリケーションに影響が及ぶのを防ぐこともできます。カスタマイズ可能なダッシュボードとビジネスジャーニーマッピングでは、AIエージェントがアプリケーションのパフォーマンスやビジネストランザクションに与える影響をさらに詳細に可視化できます。

AppDynamicsのAI Agent Monitoringを使えば、AIイニシアチブを自信を持って管理、拡張することで、コンプライアンスを強化し、コストを抑制して、ミッションクリティカルなサービスの健全性を維持できます。

SplunkとAGNTCY:AIオブザーバビリティの未来を切り開く

「エージェントのインターネット(IoA:Internet of Agents)」の実現を後押しする仕様、コード、サービスの確立という大胆なミッションを掲げるオープンソース団体「AGNTCY」が、Linux Foundationへのプロジェクト移譲を発表しました。この先見性のあるイニシアチブが見据えるのは、あらゆるベンダーや組織のエージェントがシームレスかつ安全に連携する未来です。AGNTCYプロジェクトには現時点で、シスコ、Google、Red Hat、Dell、Oracleなどの業界リーダー各社を含む75以上の組織が参加しています。

Splunkは、オープンスタンダードを活用してIT運用チームやエンジニアリングチームを支援するというコミットメントの下、Linux FoundationのプロジェクトとなったAGNTCYと連携して、生成AIおよびマルチエージェントシステム(MAS)のメトリクス、イベント、ログ、トレース(MELT)を対象としたOpenTelemetryセマンティック規約とインストルメンテーションの開発を加速しています。こうした共通の標準を推進することで、お客様はLLM (大規模言語モデル)とエージェント型アプリケーションに対してベンダーに依存しない一貫性のあるテレメトリを収集できるようになり、同時にAI Agent Monitoringの機能が強化されます。

Splunkは、AGNTCYのMetrics Compute Engineなどのコンポーネント開発に貢献し、それらを活用して、LLMやエージェント型アプリケーションの高度な品質メトリクス(事実性や一貫性など)と基本的なメトリクス(遅延やエラー率など)をオープンスタンダード形式で提供します。

「私たちは、エージェント検出、ID管理、セキュアメッセージング、フレームワークをまたぐオブザーバビリティなど、マルチエージェントソフトウェアについて誰もが直面する問題を解決するためにAGNTCYを立ち上げました。Splunkは、AGNTCYの標準をOpenTelemetryに取り込んで、開発者がエージェントのパフォーマンスを把握できるようにするための一貫したテレメトリを提供します」— シスコOutshift部門GM兼SVP、Vijoy Pandey

SplunkとAGNTCYは、エージェントの監視と評価を強化する次世代のメトリクスや機能をいち早く開発し、エージェント型アプリケーションの開発と運用に役立つ包括的なインサイトを提供して、「エージェントのワークフロー、ツールの呼び出し、動作、パフォーマンス」に関する品質の測定とドリフトの検出を支援します。

今すぐお試しください

AI Infrastructure Monitoringの設定方法はこちらでご覧いただけます。また、Observability CloudのAI Agent Monitoringのアルファプログラムにはこちらからご参加いただけます。ぜひ実際にお使いになり、Splunkの製品チームにフィードバックをお寄せください。

ここで説明した製品および機能の多くは、現在、さまざまな開発段階にあり、利用可能になった時点で提供されます。これらの製品および機能の提供スケジュールは、シスコの独自の裁量で変更される場合があります。シスコは、この文書に記載されている製品または機能の提供の遅延および中止について一切の責任を負いません。